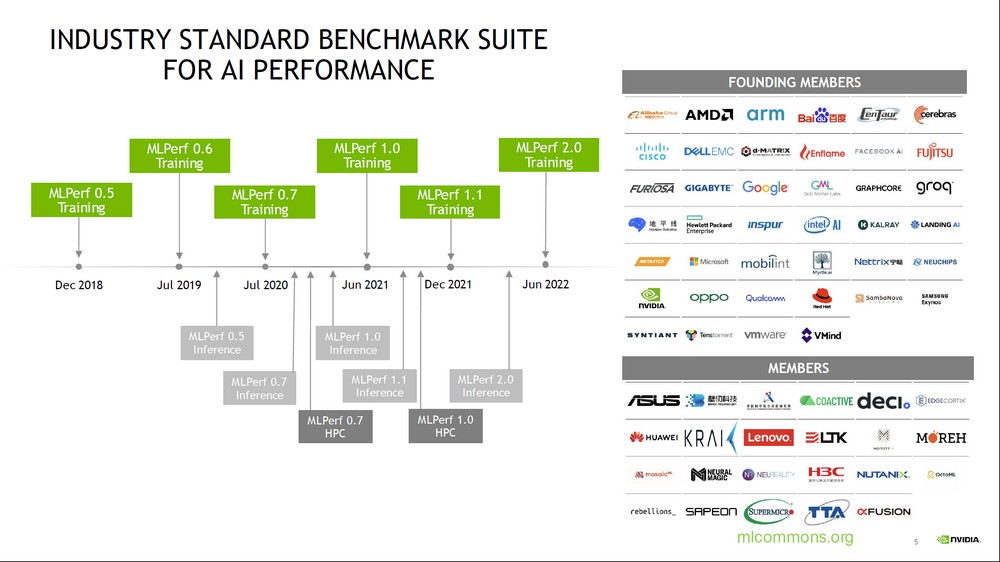

NVIDIA 與合作夥伴在 MLPerf 基準測試中以 A100 展現頂尖效能

NVIDIA 與合作夥伴持續在 AI 訓練成果 MLPerf 基準測試中獲得相當出色的成績,這份測試結果點出了 NVIDIA AI 平台頂尖的多功能性及其廣泛的生態系,NVIDIA 與合作夥伴提交的測試成果佔所有提交結果的 90%。NVIDIA AI 平台也完成了 MLPerf 訓練 2.0 中八個完整的測試項目。

沒有其他的加速器能夠完成所有基準測試,這些測試代表業界廣泛採用的 AI 應用,包括語音辨識、自然語言處理、推薦系統、物件偵測、圖像分類等。而 NVIDIA 自 2018 年 12 月第一次向 MLPerf 這個業界標準的 AI 基準測試提交成果以來,始終都是完成所有測試的參賽者。

頂尖基準測試結果及可用性

在連續四年提交的 MLPerf 基準測試中, 基於 NVIDIA Ampere 架構的 NVIDIA A100 Tensor 核心 GPU 持續締造優異的表現。

Selene 以最快的速度完成了八項訓練測試中的其中四項。Selene 是 NVIDIA 內部的 AI 超級電腦,基於模組化 NVIDIA DGX SuperPOD 建置而成,並由 NVIDIA A100 GPU、NVIDIA 的軟體堆疊和 NVIDIA InfiniBand 網路技術互連。

圖二_為了計算每個晶片的效能,此圖表將每個提交結果調整至最接近最快參賽者的規模,最快的參賽者以 1x 表示。為了判定最快的選手,我們採用多數參賽者使用的規模。

NVIDIA A100 GPU 也持續引領在單一晶片的領導地位,在八項測試中奪得六項冠軍。

許多模型驅動著應用於真實世界的 AI 應用程式

AI 應用程式可能需要理解用戶的語音請求內容、對圖片進行分類、提出建議,並以語音訊息的方式做出回應。

這些工作需要用到多種 AI 模型,用戶需要快速靈活地設計、訓練、部署和最佳化這些模型。

這也是 NVIDIA AI 平台提供的多功能性和頂尖效能對於真實世界中的 AI 至關重要的原因。

藉由 AI 提供投資報酬率

對於客戶而言,他們的資料科學和工程團隊是最寶貴的資源,他們的生產力決定 AI 基礎設施的投資報酬率。

AI 研究人員的生產力取決於快速測試新想法的能力,除了需要能夠訓練任何模型的多功能性,也需要大規模訓練這些模型所提供的速度。

此外,AI 基礎設施的運用仰賴於它的可替代性,或在單一平台上加速整個 AI 工作流程 (從資料準備、訓練到推論) 的能力。

借助 NVIDIA AI,客戶可以為整個 AI 流程使用相同的基礎架構、重新調整其用途,以滿足資料準備、訓練和推論之間的不同需求,從而帶來極高的投資報酬率。

而且,隨著研究人員發現新的 AI 突破,支援最新模型的創新是極大化 AI 基礎設施運用的關鍵。

NVIDIA AI 提供最高的每一美元單位生產力,因為它對每個模型都具有通用性和高效能,可擴展至任何規模,並可從端到端加速 AI,無論是資料準備、訓練與推論皆然。

今天公布的最新測試結果證明,NVIDIA 在迄今的每一次 MLPerf 訓練、推論及高效能運算測試項目中,均具備廣泛且深入的 AI 技術。

三年半提高了 23 倍的效能

自 A100 首次參與 MLPerf 測試以來的兩年中,我們的平台提升了 6 倍以上的效能,而持續進行軟體堆疊最佳化則有助於推動這些效益。

NVIDIA AI 平台在 3.5 年內提高了 23 倍的效能,這是橫跨 GPU、軟體和大規模改善的全方位創新的成果。

今年三月宣布推出的 NVIDIA Hopper 架構有望在日後取得更優異的成果。

我們是如何寫下如此亮眼的成績

軟體的創新繼續釋放 NVIDIA Ampere 架構的更多效能。

以 CUDA Graphs 為例,它是一款能幫助在許多加速器上運行的作業負載降至最低的軟體,該軟體在此次的提交成果中被廣泛使用。

我們用於加速 GPU 深度學習的 cuDNN 函式庫的最佳化,有助於將大規模 ResNet-50 的傳輸量提高 4% 以上,並將單一節點 3D U-Net 的速度提高超過 5%。

而且,NVIDIA DALI (用於快速加載大量音訊、圖片或影片資料的函式庫) 的增強有助於提高 RNN-T 效能。

所有人都能從 MLPerf 資源庫取得 NVIDIA 使用的各種軟體以獲得世界級的成果。我們不斷將這些最佳化結果放入 NGC (我們的 GPU 應用軟體中樞) 的容器內,並提供 NVIDIA AI 企業級的優化軟體,並由 NVIDIA 提供全方位的支援。

source: blogs.nvidia.com