秒殺 Intel Xeon,NVIDIA的深度學習超級電腦強在哪?

硬體和演算法在人工智慧領域的作用可以說是各佔一半的,而在硬體層面上,業界幾乎觀點一致,GPU 在人工智慧深度學習演算法上的重要性遠高於 CPU,這也就是為何 NVIDIA 在人工智慧領域的鋒頭甚至蓋過了Intel。

毫無疑問,GPU 是當下訓練深度學習神經網路最熱門的方法,這種方案已經受到了 Google、微軟、IBM、豐田以及百度等企業的青睞,因此 GPU 廠商在最近兩年逐漸成為眾企業膜拜的對象。

作為 GPU 領域的絕對主導者,NVIDIA 最近動作頻頻,今年早些時候公司專為深度神經網路推出了 Tesla P100 GPU,並且發布了基於該 GPU 的單機深度學習超級電腦——NVIDIA DGX-1。

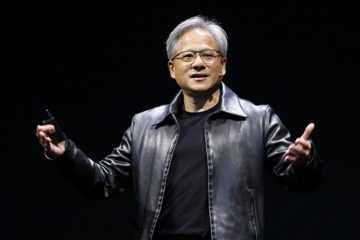

如今這款深度學習超級電腦已經問世,NVIDIA CEO 黃仁勳日前將 DGX-1 交付給了馬斯克創辦的人工智慧項目 OpenAI,OpenAI 會用 DGX-1 做什麼項目?如何使用?還不得而知,不過我們可以先聊一聊這款深度學習超級電腦到底是什麼?它有什麼厲害的地方。

深度學習超級電腦是什麼?

黃仁勳曾表示,3000 人花費 3 年時間才研發出來這樣一款 DGX-1,深度學習超級電腦研發的難度之大可見一斑。

根據 NVIDIA 官方的介紹,DGX-1 的規格如下:

半精度(FP16) 峰值性能最高可達170 Teraflops;

8 個 Tesla P100 GPU 加速器,每顆 GPU 16GB 記憶體;

NVLink Hybrid Cube Mesh (NVLink 混合立方網格);

7TB 固態硬碟 DL 高速快取;

雙路 10 GbE,四路 InfiniBand 100Gb 網路連接;

功耗:3U – 3200W。

因為 NVIDIA 將這些硬體設計在了一個機箱內,所以 DGX-1 被稱為單機深度學習超級電腦。

Tesla P100 有 153 億個 16nm FinFET 晶體管,其核心面積達到了 610mm²,按照黃仁勳的說法,這款 GPU 是迄今為止最大的晶片。

DGX-1 整合的 8 個 16GB 顯示記憶體 GPU 吞吐量相當於 250 台傳統伺服器的水平,其配置的 7 TB 固態硬碟用於儲存神經網路訓練的大量原始數據。

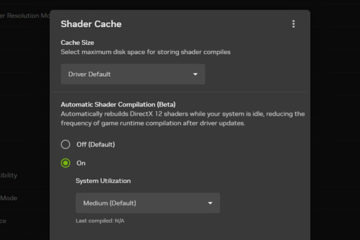

除此之外,DGX-1 系統還包含一套深度學習軟體,即深度學習 GPU 訓練系統 (DIGITS™),它可用於設計深度神經網路 (DNN),據了解 DGX-1 可以將深度學習的培訓速度加快75倍,將 CPU 性能提升56倍。這是什麼樣的概念呢?

Intel 雙路 Xeon 系統需要 250 多個節點和 150 個小時來訓練 Alexnet,而 DGX-1 只需要一個節點 2 個小時,後者在性能和節點總頻寬上都有明顯的優勢。當然在性能的提升下,功耗達到了 3200W,售價更是高達 129000 美元。

GPU是唯一選擇嗎?

雖然 GPU 相比 CPU 有一定的優勢,但是在 FPGA 和神經網路晶片面前,GPU 依然要遜色不少。

有研究人員測試,相比 GPU,FPGA 的架構更靈活,單位能耗下性能更強。深度學習演算法在 FPGA 上能夠更快、更有效地運行,而且功耗也能做到更低。Intel 甚至為此推出了 FPGA 和 CPU 的混合晶片架構。

另一個研究方向就是神經網路晶片,這一領域的代表當屬 IBM 的 TrueNorth 和寒武紀的 DianNao。根據模擬實驗測試的結果,採用 DianNaoYu 指令集的寒武紀深度學習處理器相對於 x86 指令集的 CPU 有兩個數量級的性能提升;而 IBM 的 Truenorth 裡含有 54 億個低成本晶體管神經突觸晶片,功耗卻低至 700 毫瓦,在性能以及功耗的優化上都提升到了一個新的高度。

寒武紀神經網路處理器研究者、中國科學院計算技術研究所研究員陳雲霽表示,“加速晶片是神經網路晶片的最終形態。”

但是理想很豐滿,現實很骨感!就目前來說,GPU是唯一實現大規模應用的方案,FPGA或者神經網路晶片想要取代GPU的地位只能說是路漫漫了!